作者:Lepton.AI

时间:2024年9月3日

翻译:litianc 2024年11月2日

前言:H100作为全球范围内领先的算力产品,经过近两年的推广,我注意到一个现象:尽管对于有实际经验的用户来说,GPU算力已经得心应手,但对于许多企业的采购人员、新普AI技术人才,以及一部分算力投资者而言,H100/H20等算力产品在市场上的基础认知仍有较大的提升空间。最近,我在说读中发现了一篇相关文章,因此将其翻译并转载于此,为了阅读的连贯性,删去了软文中明显的植入广告。无论如何Lepton是我们行业从业者应当尊敬的一家公司,有兴趣的朋友可以阅读原文英文博客以获得更深入的了解。

GPU市场可能很复杂,难以驾驭。如果您花了数小时搜索有关H100市场的信息,您可能已经遇到过无数带有类似消息的报价:“与我们的销售人员交谈。所有GPU基础设施选项可能看起来都相似,但您知道它们并非如此,尤其是如果您听说过有关管理GPU集群的稳定性问题和隐藏挑战的故事。那么,你转向哪里呢?

如果这些听起来很熟悉,那么您来对地方了。我们认识到缺乏GPU市场的全面指南,我们在这里分享我们的见解,尤其是关于旗舰H100 GPU的见解。截至2024年8月下旬,本指南将涵盖:

- 市场上各种期权的一般价格是多少?

- 如何确保GPU可靠?

- GPU以外的硬件规格重要吗?

- GPU在哪里?位置重要吗?

获取GPU:定价

首先,价格。一个简短的总结是,H100的价格将保持一段时间,但最终会下降,而且租赁期限越来越短,允许更灵活的容量规划。我们将介绍租用和购买GPU之间的比较,并按关键参数细分价格。

租金:从短期到长期的期望

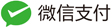

H100&A100不同周期的每小时价格

市场回报可预测性

到目前为止,访问H100 GPU的最常见方式是预留计算容量。这是因为GPU价格昂贵,而供应商不喜欢闲置GPU的想法。预订提供了可预测性,您作为用户反过来会以更优惠的价格获得奖励。

预留通常从最低6个月的承诺开始。对于小型集群(16到512个GPU之间),目前的公平基准定价约为6个月承诺2.60美元/小时,12个月承诺2.40美元/小时,长期承诺低于2.20美元/小时。这些价格包括满载配置,具有服务器级CPU、2TB内存、40TB NVMe InfiniBand/RoCE互连(我们稍后将介绍硬件规格)。根据具体地点,美国境外的定价可能会有所不同,桌些地区会根据当地情况提供更低或更高的费率。但一般来说,如果您看到价格与上述价格明显不同,您可能会询问根本原因,以确保您与一家好的供应商合作。

对于大规模集群(超过512个GPU),定价变化很大,并且取决于多个因素,因此很难建立标准基准。

按需正在变得重要

在2023年底和2024年初,按需访问GPU几乎是不可能的。尽管LambdaLabs以每小时3.50美元左右的价格提供按需H100 GPU,但可用性极其有限,通常需要运气好才能获得机器。我们看到按需土地也即将发生变化。目前,按需H100 GPU更容易获得,Lambda Labs、Voltage Park、Digital Ocean、Runpod 和 CoreWeave 在内的多家供应商的价格约为每小时3至3.5美元。但是,这些按需H100 GPU通常存在局限性,例如缺乏高带宽GPU结构(如InfiniBand 或 RoCE),以及等待时间比基于 CPU 的正常按需资源长。

A100作为H100定价趋势的基准

A100 GPU的历史为我们提供了对H100市场当前趋势的有用见解。当A100于2020年首次发布时,租金为每小时2.4美元。到2023年,这个价格已经下降到每小时1.8美元,到2024年,它进一步下降到每小时1.4美元左右。价格下降的同时,可用性也显著增加。例如,Azure现在提供具有合理可用性和有吸引力的折扣的A100Spot实例

H100似乎正在遵循类似的路径,价格在过去一年中下跌了约 20% 。交货时间过去长达6个月,现在已缩短到几周甚至更短。然而,H100的定价仍不清楚,并且深受营销策略的影响。

展望未来,由于即将推出的Blackwell GPU的不确定性和不断变化的需求,预测未来的H100价格很困难。即便如此,我们预计供应将不断改善,定价将变得更加清晰。随看可用性问题减少,可靠性、支持和软件功能等因素在选择不同的GPU时将变得更加重要。

购买:成本明细

另一种选择是预先购买机器。“我听说云提供商收取高额保费。我应该只构建自己的GPU集群吗?”如果您想这样做,或者您只是想快速了解一下成本明细,请继续阅读。

我们将做出一些会计假设:机器和其他部件将在4年内线性废弃;我们假设4年内价格都相同;我们忽略了财务因素(购买需要更高的预付款)。当然,这些都是粗略的简化,但它们有助于使数学变得清晰。我们还会将所有内容转换为“每小时每GPU”价格,以便于比较。

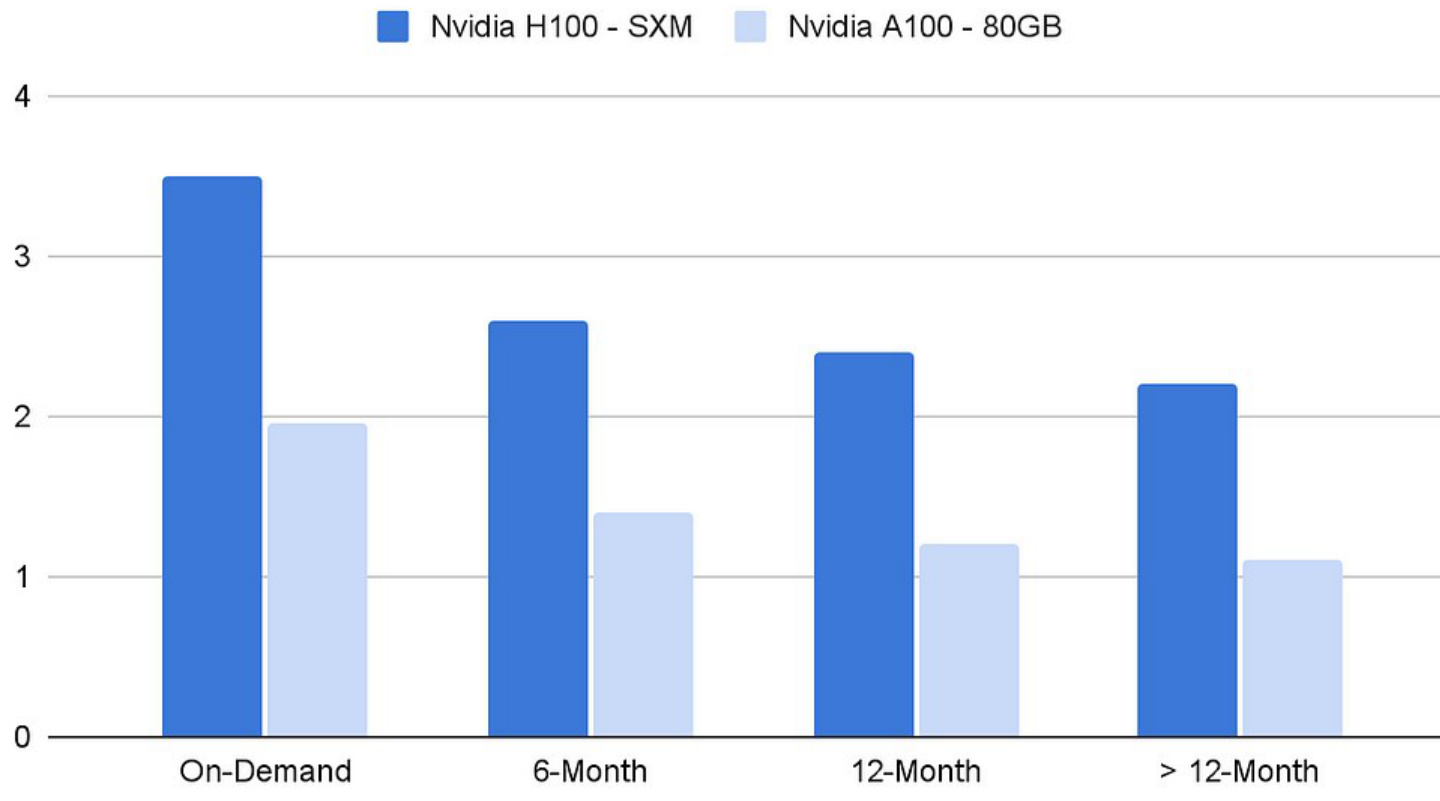

我们将成本分解为以下部分:计算硬件、网络硬件、电力和其他IDC成本以及备件。

H100 BOM成本明细

计算硬件:1.1美元/小时

主要成本因素无疑是硬件。配备8个H100 GPU的戴尔HGX系统,通常配备2TB内存和40TB NVMe存储,售价约为280,000美元。Supermicro的类似配置略便宜,约为270,000 美元。考虑到销售税,这相当于每GPU小时约1.10美元。

网络硬件:0.2美元/小时

通常,如果为大规模分布式计算构建迷你集群,则还希望放置一个高性能网络。通常,这涉及两部分:服务器上的网络设备以及用于连接服务的交换机和电缆。根据集群的规格和大小,预计网络成本将占计算机成本的 20% 以上。您可以在本文的后面部分阅读有关网络规格的更多信息。我们大致估计每GPU小时0.2美元左右。

电力和其他IDC成本:0.3美元/小时

每个充分利用的H100GPU消耗大约800瓦的功率。美国的平均电力和IDC租金成本约为每月每千瓦200美元,因此每个GPU每月的能源成本约为160美元。此外,每台机器的现场维护服务费(有时称为“智能手”)通常需要每三个月1小时,费率为每小时150美元。因此,运行H100GPU的每月总成本约为每卡小时0.3美元。

备件:0.1美元/小时

为了实现 $99.9\%$ 的正常运行时间,通常需要保持 $3–5\%$ 的备件储备。但是,即使采取了这种预防措施,一些不可避免的硬件或网络问题仍可能导致偶尔的进一步停机。在本次讨论中,我们乐观地使用 $5\%$ 的准备金作为我们的基线。我们还考虑了与更换备件相关的潜在停机时间,估计总成本约为每小时0.1美元。

未涵盖的内容

上述成本明细导致4年的总成本约为1.7美元/小时。请注意,这仅涉及BOM成本,并且您可能会投入一定数量的人力资源来启动并运行自己的集群。这包括从“由自己的研究人员管理”到“专门的SRE任务组”,具体取决于专用GPU集群的规模和复杂性。肯定会有复杂性,例如脾气暴躁的研究团队或非微不足道的运营成本,但这些可能很难以标准方式进行分析。

如果您是一家初创公司,您可能想问一这值得吗?这就引出了下一个问题。

租赁还是自建?

这是一个很难的问题,但多年的观察使我们略微倾向租赁,原因如下:

- 价格下降。4年是一段很长的时间。H100的租金价格肯定会持续下降,因此购买的好处可能会比预期的更快衰减。

- 较低的前期成本:每台HG×机器的成本约为6辆特斯拉ModelY。租房可以给你更好的现金流,特别是如果你花了昂贵的风险投资。

- 更好的灵活性:如果您需要扩展或缩减计算资源,至少在每个租赁期限结束时,租用相对容易。扩展您拥有的集群将更加棘手;您的数据中心机架空间用完的情况并不少见,您必须为另一个数据中心驱动您的集群。

当然,也有购买的理由,例如:

- 数据安全和相关考虑因素至关重要,您确实需要一个气隙系统。

- 您绝对致力于为确定的几年使用量进行固定数量的计算。

与原始GPU基础设施提供商不同,我们帮助的用户高效地运行计算,无论是租用GPU计算容量还是专用集群。 我们的客户通过拥有一个完全云原生的平台来管理GPU、编排训练作业和推理服务,并以高效的方式运行AI工作负载,从而充分利用了这些容量。

使用GPU:可靠性

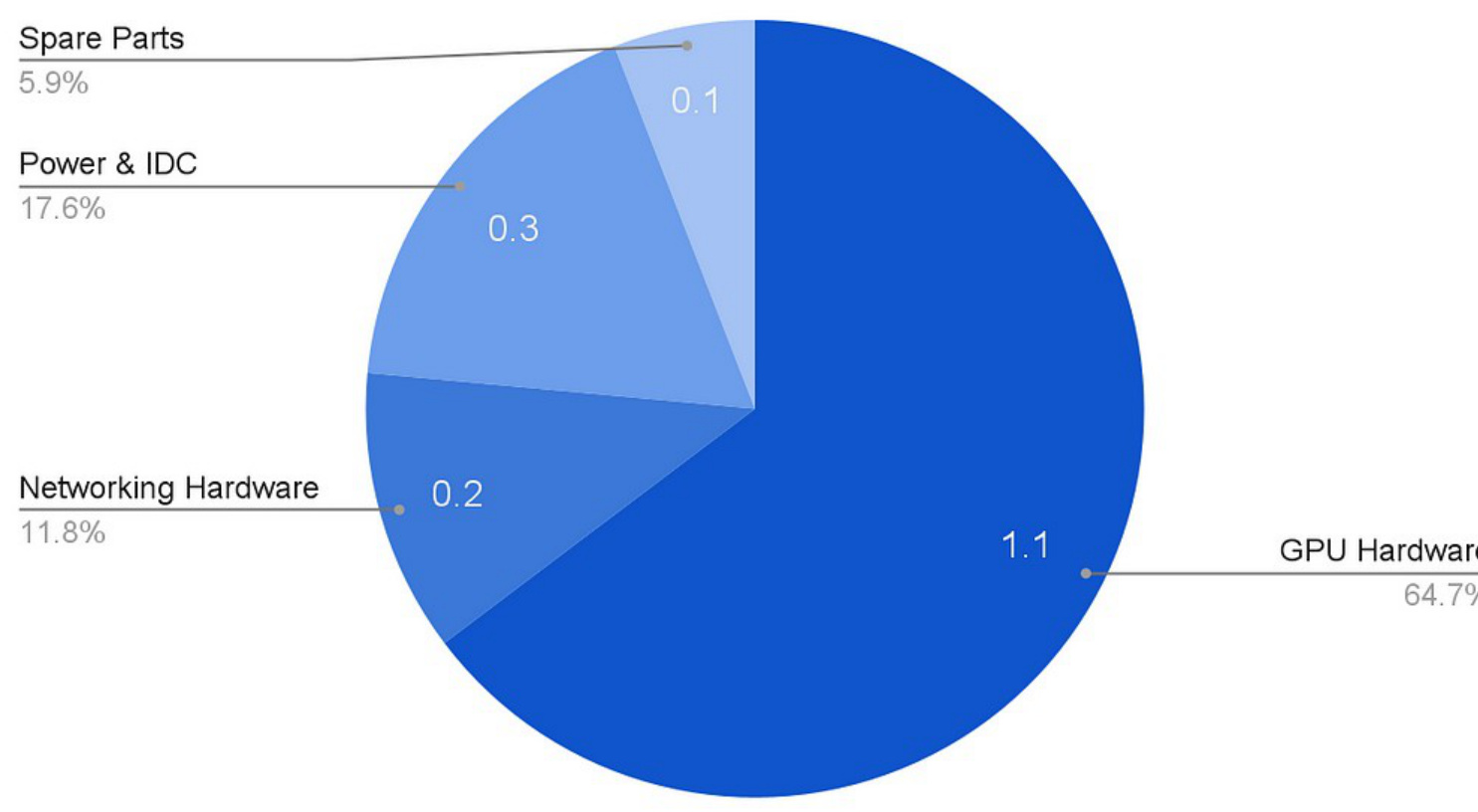

GPU快速而松散。通常,它们比传统的CPU计算机更频繁地遇到故障。如果您管理大约100个GPU卡,则预计每月至少会发生一次卡故障是合理的。在最近一篇介绍GPUd的博客文章中,我们讨论了GPU的可靠性和恢复。领先的GenAI公司也进行了类似的观察,例如Meta,在Llama3405B预培训的54天期间,每天约有8.6次工作中断。

Llama3405B预训练54天期间中断的根本原因

因此,无论您是租用还是购买GPU,询问您的提供商是否执行以下操作都至关重要:

- 他们在交付前是否进行了彻底的预生产和老化测试?

- 他们在集群运行期间是否进行了广泛的主动监控?

- 是否有IDC现场人员支持,SLA保证是什么?

全面的预生产和老化测试

GPU在首次启动时往往具有较高的故障率。部署GPU机器之前最关键的步骤之一是消除错误配置和到达时死机组件。与纯CPU系统不同,GPU计算机具有更复杂的组件,需要超出标准CPU基准测试的全面测试。常见测试包括GPU老化和NCCLall-reduce测试。此类测试可确保满足基本硬件规格。

我们在更进一步。在向客户交付H100 GPU机器之前,我们不仅进行了标准的老化测试,还运行了流行的训练框架,如torch.distributed 和 DeepSpeed,以验证端到端的训练性能。我们发现了隐藏的问题,例如潜在的ECC错误、由于GPU-GPU通信、以太网或存储而导致的速度减慢,以及GPU集群与外部互联网之间的网络吞吐量。因此,我们的客户从第一大起就收到了经过全面优化的机器,并为要求奇刻的工作负载做好准备。

广泛的主动监控

持续监控是必不可少的。没有人希望GPU在凌晨3点坏掉,却在早上9点被识别出来。您的基础设施提供商至少应配置IPMI或类似工具来跟踪基本硬件状态和PCI状态。这可以检测GPU与PCIe总线断开连接或NVMe磁盘故障等常见问题。一些高级IaaS(基础设施即服务提供商)提供额外的全面GPU-GPU和数据中心网络监控,但我们发现这种级别的服务很少见。在撰写本博客时,我们还没有看到任何提供商(包括AWS或GCP)提供全面、主动的GPU运行状况监控(ECC错误、电源问题、NVLink状态等)。这些通常由用户负责。

我们相信用户应该获得更好的可靠性。这就是我们开源GPUd的原因:通过主动监控GPU和有效管理AI/ML工作负载来确保GPU效率和可靠性。

我们在每台机器上都部署了GPUD,以确保GPU和相关组件的完整监控覆盖。这使我们能够检测潜在故障的早期迹象,并进行详细的诊断以确定问题的根本原因。通过这样做,我们可以确定将集群恢复到正常状态的最有效方法。这也有助于确保满足SLA,并使您能够在必要时从提供商那里获得适当的退款。

一个典型的例子是ECC错误:虽然“软件ECC错误”通常被认为是“可纠正的”,但我们发现它们在密集使用的几天内始终会导致无法纠正的硬件故障。因此,我们可以主动污染节点并进行预测性维护。这消除了对我们的客户的不必要干扰,包括训练和推理。对于我们的供应商合作伙伴来说,这也有助于提高SLA和端到端的整体满意度。

IDC现场人员配备和SLA保证

大多数基础设施提供商都宣传24/7现场支持,但服务质量可能会因员工可用性而有很大差异。此外,24/7现场保证并不总是转化为机器故障的快速解决,尤其是当问题超出简单的重启范围时。常见的数据中心任务包括重置GPU卡、更换或重新连接网络电缆以及对电源设备进行故障排除。但是,识别这些问题可能需要额外的时间。

为了应对这一挑战,我们开发了GPUD,这是一种主动工具,可监控机器状态并帮助快速查明问题的根本原因。一旦发现问题,现场工作人员通常可以在几个小时内解决问题,从而最大限度地降低延长停机时间的风险。

服务水平协议(SLA)要求提供商对其绩效负责,如果未达到标准,则会提供补偿。但是,请务必注意,GPU集群的SLA通常与常规CPU集群的SLA不同。虽然大多数提供商为控制平面提供高SLA保证,但GPU的正常运行时间保证通常较低,因为与CPU相比,GPU的故障率更高,迁移和虚拟化的难度更大。这些措施共同确保平稳运营、及时解决问题并防止重大业务中断。

硬件规格:数据中心视图

猜不出来,GPU没有外围设备就无法运行,而且它周围的基础设施相当复杂和复杂。您购买的不是单张卡。这样的周围基础设施与GPU一样重要,以确保您获得最佳的系统性能。我们将为您提供有关GPU服务器、网络、CPU和内存、存储等选择的更多信息。

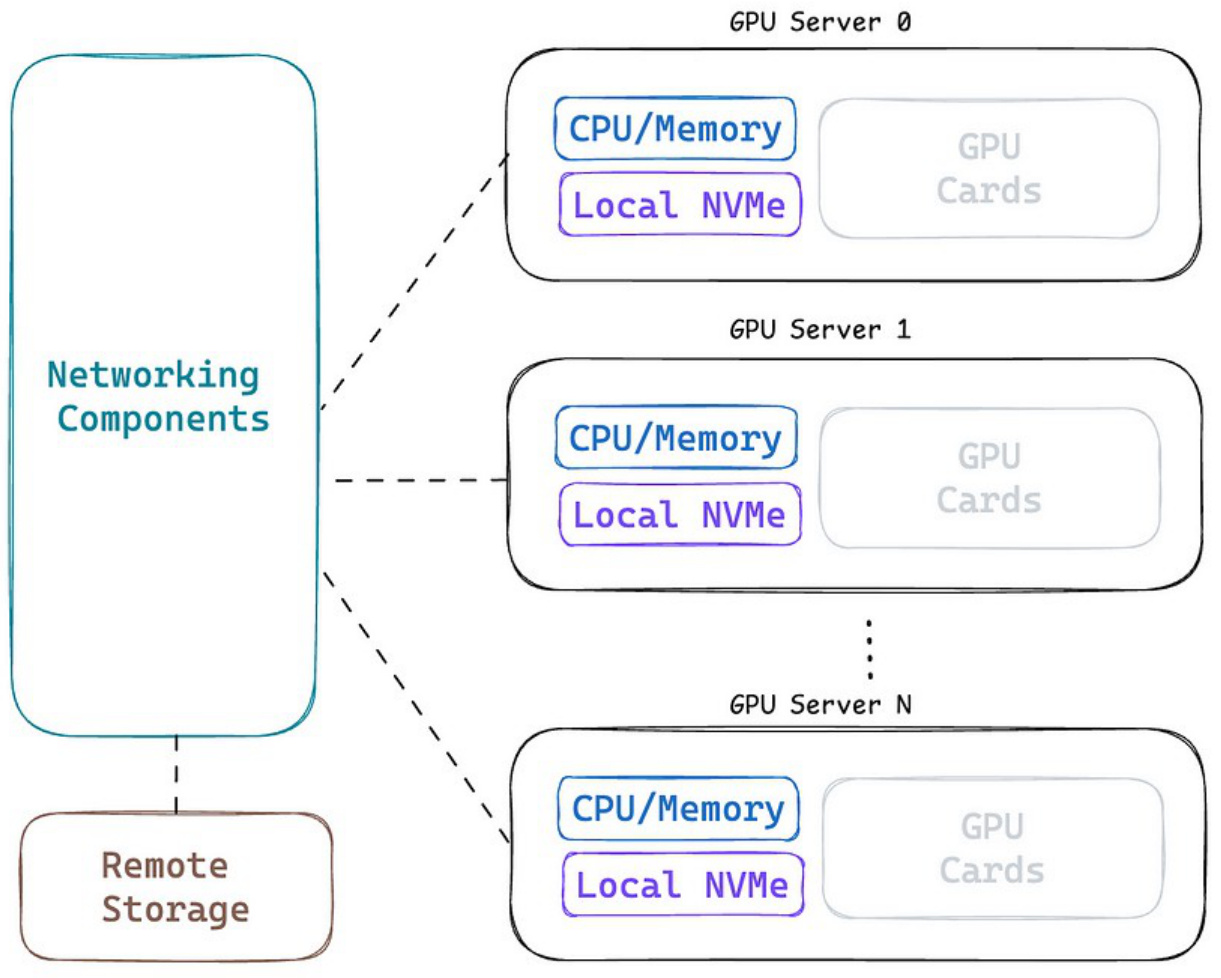

GPU集群的简化视图。

GPU服务器

Nvidia H100 HGX系统由几家主要供应商提供,包括但不限于Dell、Gigabyte 和 Supermicro。相似,并且不是一个显著的差异化因素,但需要牢记供应商特定的注意事项,例如PSU、冷却和其他与硬件相关的问题。但是,随看H100平台的成熟,这些问题通常通过固件和部件更新来解决。

我们在交付、安装、客户支持和事件响应方面与Supermicro合作取得了积极的体验。市场上的其他参与者可能更喜欢戴尔,因为它具有广泛的可用性和支持网络。总体而言,随看H100的成熟,GPU机器本身是一个相对标准的产品。随着配备Blackwell GPU NVidia NVL36/NVL72的推出,这可能会发生变化,因此我们会持续关注它们。此外,如果您正在构建集群,您可能希望与AMAX等系统集成商合作,除了单个服务器之外,他们还将提供更多的端到端解决方案。

GPU网络

GPU网络专注于GPU之间的高性能、低延迟互连,因此您可以高效地进行分布式训练。通常有两种选择:InfiniBand(有时称为IB)和通过融合以太网的远程直接内存访问(RoCE)。这两种选择都可以提供高网络带宽,InfiniBand的端口到端口延迟略低(~200ns),而RoCE更像是一个开放标准。

一个常见的误解是InfiniBand对于培训至关重要。然而,RoCE多年来已经成熟起来,其能力通过具有超大规模训练基础设施的LLAMA3.1等领先模型得到证明。总的来说,InfiniBand更加省心,并附带成熟的商用Fabric管理解决方案,例如NVidia UFM。RoCE通常提供更好的可用性,并且可以说更具可扩展性,尽管这需要专业知识。

根据我们的经验,对于少于1000个GPU的训练集群,RoCE和InfiniBand之间的差异很小。如果您自己构建和管理集群:InfiniBand可能会提供一些操作优势。然而,RoCE是一个同样可行的选择,通常价格更具竞争力。

在这两种情况下,可用带宽都是值得一提的设计因素。一个流行的选择是8路Infiniband或RoCE网卡,每个网卡提供400GB的吞吐量。这就是为什么您经常在供应商那里听到“3.2T互连”。在实践中,您还可以将其减少为4路或2路,并且仍然可以有效地训练大多数模型。不过,我们确实发现许多提供商提供8路以确保未来。

CPU/内存

鉴于H100GPU的高成本,CPU和内存的费用在总成本中占比相对较小,通常约为整台机器的 $10\%$ 。大多数提供商都为其系统配备了CPU和内存,以最大限度地提高性能。对于具有8个H100GPU的计算机,通常会看到具有超过96个物理内核或192 v CPU,Intel Xeon Platinum Sapphire Rapids 或 AMD 9004。内存配置通常包括2TB,但1TB也是一个可行的选择。

建议充分利用可用的CPU和内存资源,以确保它们在训练或推理过程中不会成为瓶颈。

存储

快速本地存储对于AI工作负载中的训练和推理任务都至关重要。理想情况下,机器应配备至少20TB的NVMe存储,但高性能系统通常提供40TB或更多。本地磁盘应足够大,以容纳服务器在训练或推理期间所需的整个数据集,从而减少网络依赖性并最大限度地提高本地GPU的性能。

但是,对于涉及图像、视频和音频训练等大型数据集的任务,存储需求通常会超过本地容量,因此需要使用远程存储解决方案。NFS,Lustre、VAST We ka替代品也很受欢迎。此外,S3、Minio或Ceph等对象存储选项也是可行的,尽管研究人员通常更熟悉POSIX文件系统。每个GPU至少应具有200MB/s的读取吞吐量,系统支持1GB/s的机器范围写入吞吐量以进行检查点。

除了存储容量之外,还经常会出现其他挑战,例如处理大量小文件。例如,每个小图像或视频可能只有几千字节,研究人员通常更喜欢直接从无服务器存储随机访问。

为了满足这些需求,需要开发了一种专为AI训练量身定制的通用存储解决方案。我们兼容POSIX的分布式文件系统将数据保存在远程存储或对象存储上,同时以对等、无服务器的方式将其缓存在本地NVMe磁盘上。这种方法提供了远程存储的可扩展性,同时保持了本地磁盘访问的性能和简单性。

位置、位置、位置 (重要说3遍)

如今,GPU供应商遍布全球。北美是最受欢迎的托管选择,因为它的电力成本较低、网络费率实惠且零件可用性更好。欧洲排名第二,而亚太地区的带宽和电力成本通常较高。(以中国大陆为例,一线城市和西部偏远地区的综合建设成本会有较大差异,主要体现在土地费和电费上。)但GPU租赁价格也取决于需求,因此价格并非线性关系。

对于训练,只要您可以将训练数据块(通常为TB或低PB规模)移入和移出集群一次,位置就不那么重要。对于推理,延迟和可靠性是重要因素。将您的基础设施放置在靠近大多数客户群的位置非常重要。此外,将容量分配到多个位置有助于防正单点故障并增强网络稳健性。经验法则:美国东部到美国西部增加了大约60毫秒的延迟,美国到亚太地区增加了大约150毫秒的延迟。

我们还采用了大量的接入点(POP)节点,以便将GPU和客户端之间的延迟降至最低。

结论

无论是构建自己的集群还是从IaaS提供商处租用GPU,在原始计算能力和完全启动和运行的高性能训练作业之间还有很长的路要走。计算、存储、联网和特定于模型的优化都涉及,以提高一切效率。

无论您是想购买还是租赁H100 GPU,都可以在此处联系我们我们期待您的来信,并在您的旅程中为您提供帮助!